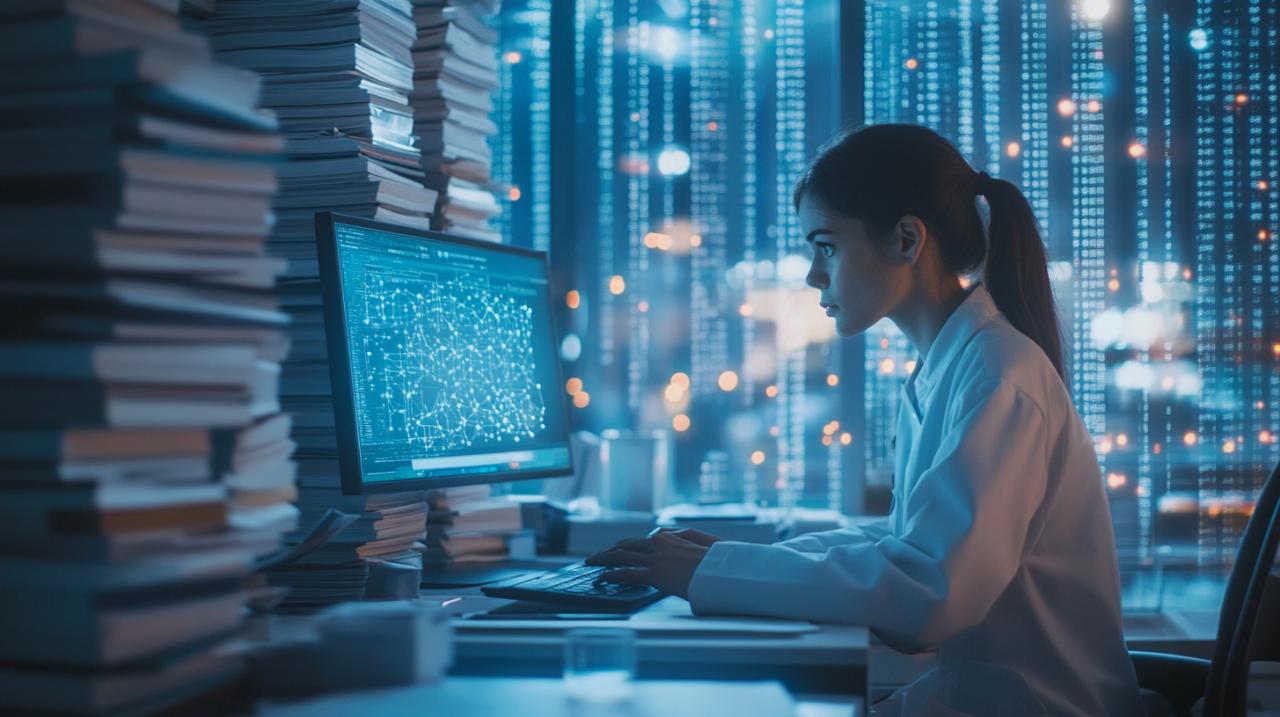

La capacidad de extraer significado real de la información científica se ha convertido en una competencia fundamental en la era digital. Cada día se generan miles de estudios y análisis que, sin una lectura crítica adecuada, permanecen como simples acumulaciones de cifras sin contexto. Comprender cómo transformar estos hallazgos en conocimiento aplicable requiere dominar tanto los fundamentos metodológicos como las herramientas analíticas que permiten dar sentido a la complejidad inherente de la investigación moderna. En este proceso de interpretación, recursos como https://www.anteco.es/ pueden ofrecer perspectivas complementarias sobre cómo abordar la información de manera estructurada y eficiente.

Fundamentos para comprender la estructura de un estudio científico

Todo análisis riguroso comienza por reconocer que las investigaciones científicas siguen arquitecturas específicas diseñadas para garantizar la validez de sus conclusiones. Familiarizarse con estas estructuras permite identificar rápidamente dónde reside la información más relevante y cómo evaluar la solidez de las afirmaciones presentadas.

Identificación de los componentes esenciales de una investigación

Un estudio bien construido presenta varios elementos que funcionan como pilares de su credibilidad. La introducción contextualiza el problema abordado y justifica su relevancia, mientras que la metodología detalla los procedimientos empleados para recopilar información. Los resultados exponen los hallazgos de manera objetiva, y la discusión interpreta estos datos en relación con el conocimiento previo. Reconocer esta secuencia facilita una lectura estratégica que prioriza las secciones más pertinentes según el objetivo del lector. Las herramientas de análisis cualitativo como ATLAS.ti permiten reorganizar estos componentes para identificar ideas clave mediante visualizaciones como mapas de árbol, diagramas de Sankey y redes que revelan conexiones ocultas entre conceptos. Esta capacidad de reorganización resulta especialmente valiosa al trabajar con transcripciones de entrevistas y encuestas, notas de campo y memos de investigación que requieren un tratamiento sistemático para extraer patrones significativos.

Diferenciación entre metodologías cuantitativas y cualitativas

Las aproximaciones cuantitativas se basan en la medición numérica y el análisis estadístico para establecer relaciones entre variables, buscando generalizaciones a partir de muestras representativas. En contraste, las metodologías cualitativas profundizan en las experiencias, percepciones y significados que las personas atribuyen a fenómenos específicos, trabajando con datos textuales, visuales o auditivos que requieren interpretación contextualizada. Comprender esta distinción es crucial porque determina qué tipo de conclusiones pueden extraerse legítimamente de cada estudio. El análisis de contenido y el análisis temático representan estrategias fundamentales en la investigación cualitativa, permitiendo identificar categorías emergentes y relaciones conceptuales en grupos focales y revisiones de literatura. La formación en investigación incluye ahora el dominio de herramientas especializadas que combinan capacidades de codificación, categorización y visualización de datos cualitativos, facilitando el proceso de transformación de datos en conocimiento mediante interfaces que integran funcionalidades de análisis temático con opciones de exploración interactiva.

Estrategias efectivas para transformar datos brutos en información práctica

Una vez comprendida la estructura básica de las investigaciones, el desafío radica en convertir los hallazgos presentados en conocimiento aplicable a contextos específicos. Este proceso exige desarrollar habilidades críticas que permitan evaluar la calidad de las evidencias y determinar su relevancia práctica.

Análisis crítico de resultados y validación de conclusiones

La interpretación rigurosa implica examinar no solo qué descubrió el estudio, sino también cómo llegó a esas conclusiones y qué limitaciones presenta. Evaluar el tamaño muestral, la representatividad de los participantes y la adecuación de los instrumentos de medición ayuda a determinar la confiabilidad de los resultados. En el ámbito del Big Data, la minería de datos se divide en categorías descriptiva, predictiva, prescriptiva y de descubrimiento de conocimiento, cada una con propósitos específicos que van desde identificar patrones y tendencias hasta generar modelos predictivos para anticipar comportamientos futuros. Un Data Scientist debe dominar programación en Python, R y SQL, además de conocimientos sólidos en estadística y machine learning para construir estos modelos. La limpieza y preparación de datos constituye una fase fundamental que consume gran parte del esfuerzo analítico, pues los conjuntos de datos raramente llegan en condiciones óptimas para su procesamiento directo. Las habilidades de visualización de datos mediante herramientas como Tableau, Power BI o Matplotlib permiten comunicar resultados complejos de manera accesible, facilitando que los hallazgos científicos se traduzcan en decisiones informadas.

Aplicación del conocimiento científico en contextos reales

El verdadero valor de la investigación científica se materializa cuando sus descubrimientos se integran en la toma de decisiones cotidianas o profesionales. Esto requiere evaluar la aplicabilidad de los hallazgos considerando las características específicas del contexto donde se pretende implementarlos. El proceso de conversión de datos en información valiosa implica varios pasos secuenciales: la ingesta del dato, la ingeniería del dato que prepara y estructura la información, la aplicación de Data Science para extraer conocimiento mediante análisis estadísticos y algoritmos, la explotación del dato a través de dashboards y reportes accesibles, y finalmente la evolución del conocimiento que retroalimenta el ciclo completo. Sectores como la Administración Pública, el financiero, seguros, telecomunicaciones e industria han incorporado soluciones de observabilidad, process mining y automatización de procesos que convierten datos operacionales en mejoras tangibles de eficiencia. La alta empleabilidad en campos relacionados con Data Science refleja la demanda creciente de profesionales capaces de navegar el ecosistema complejo de bases de datos, herramientas de análisis y marcos conceptuales necesarios para extraer valor de la información disponible. La formación continua en estas disciplinas no solo aumenta las oportunidades laborales, sino que también desarrolla el pensamiento crítico necesario para evaluar la calidad y relevancia del conocimiento científico en un entorno saturado de información.